Дневник c00l0ne

-

ПопулярностьТоп-112

-

Постов10,412

-

Просмотров867,641

-

Подписок74

-

Карма автора+570

-

Shtirlitz, fastdecision, Feliz, вы не представляете как вам повезло что вы это только здесь читаете,

+20

-

+17

-

Мне однажды сказали примерно следующее: -Не так страшно ,когда человек творит откровенную чушь , куд

+17

-

Просто умножаешь дневной выигрышь на 30, что тут сложного?

+14

-

Дык не моё-ж... Цитата , мсье Ваши , сударь , раздачи - куются фартом , нелепостью и попытками подо

+14

-

-

AlphaEvolve расширяет границы алгоритмов:

Замахнулись на решение уравнения Навье-Стокса

и небольшое улучшение алгоритма умножения комплексных матриц 4х4

YandexGPT 5 Pro теперь бесплатна

-

Как переводить видео на лету

Можно пойти простым путем , скачать Yandex.Browser и использовать встроенную функцию

низкий поклон Яндексистам

но что же с хромом и firefox ?

1. идем сюда https://github.com/ilyhalight/voice-over-translation

2.

3.

4. в firefox все должно заработать , ну а в хроме:

заходим в менеджер расширений chrome

включаем галочку режим разработчика5. жмем на Сведения расширения Tampermonkey

6. включаем галочку

7. Не благодарите

чтобы включить красивые "Живые голоса" нужно еще залогиниться в настройках скрипта в яндексе , это здесь :

ждем шестеренку и входим в аккаунт, активируем нижнюю галочку

из минусов трансляции твич в реальном времени пока не переводит...

из плюсов любое видео на ютуб, любое записанное видео на твич переводит на русский с любого языка...

теперь можно посмотреть прикольные шортсы на ютубе , например этого чувака :

Резюмируем :

два пути

простой: это Яндекс.Браузер

сложнее: это скрипт установить на firefox chrome или любой другой поддерживаемый браузер(safari & etc)

Сообщение отредактировал c00l0ne - 3.7.2025, 21:44 -

c00l0ne, С Яндексом в какой то момент была проблема - перестал некоторые видео переводить. Писал что то вроде звуковая дорожка защищена (аббревиатура была из 3 букв). Темпермонк переводит все подряд.

для перевода текста оч нравится дипл

-

Еще добавлю можно вообще любой видос перевести если например сайт не поддерживается расширением, просто заливаете его на свой яндексдиск, жмете правой кнопкой на видео и выбираете поделиться, и по этой ссылке открываете видос, там уже появляется кнопка перевода.

пол года назад когда ставил расширение еще не было функции живые голоса, щас переустановил, появились, очень живо звучит

Сообщение отредактировал jerrybishop - 4.7.2025, 16:48 -

RIS

KC-V :смотреть в Яндекс.Браузере с переводом)

или установив скрипт для переводчика в chrome и firefox :D

-

ждем-с

илон не может обделаться) в очередной раз) надеемся...

-

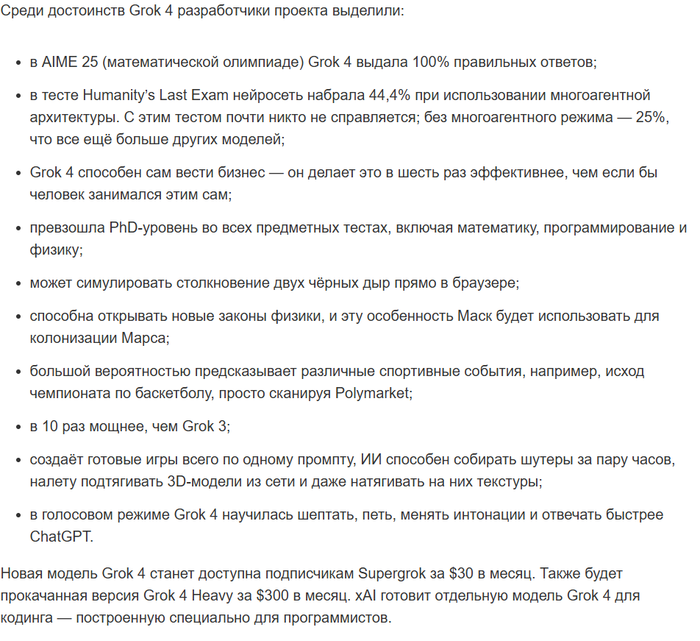

30$-300$ в мес(да тристо)

как потестировать:

открываете сайт

далее Models

выбираете Grok 4

https://openrouter.ai/x-ai/grok-4

далее Chat

не спишите задавать вопросы

далее

три точки

далее

далее

на 0 выкручиваете :

далее закрываете диалог настроек

можно чатиться

но придется пополнить баланс)

лень пока, ждем когда появится в bothub

пс интересный результат на Humanity's Last Exam

в остальном же Grok-4 пока "не убедил"

Сообщение отредактировал c00l0ne - 10.7.2025, 15:51 -

-

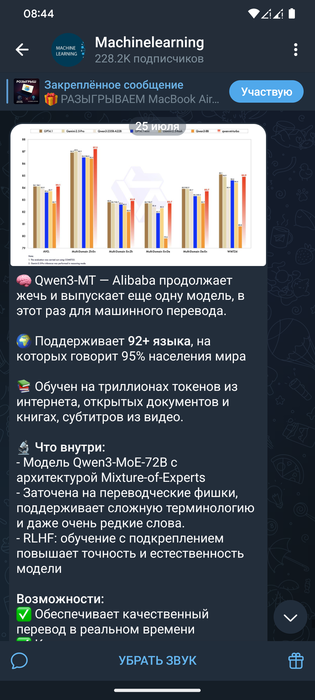

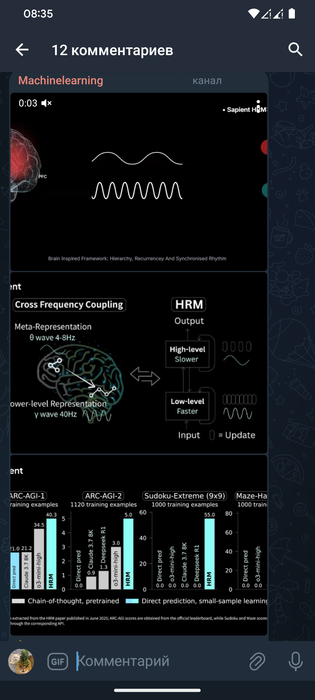

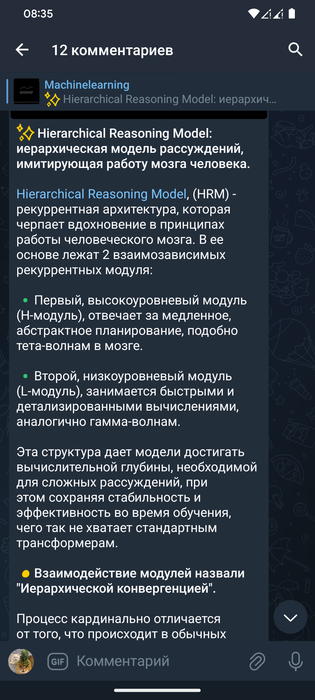

Китайцы новую архитектуру пробуют

Китайцы выпускают конкурента DeepL

Ну как конкурента, убийцу скорее

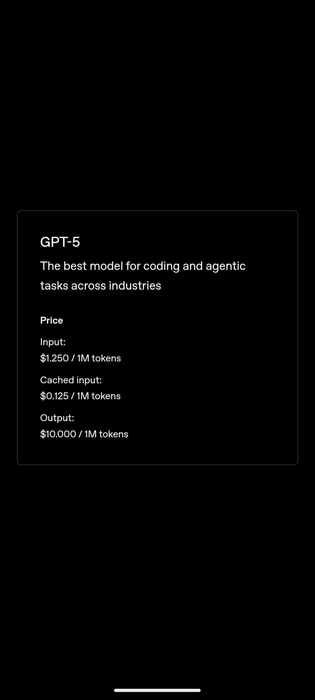

OpenAI в августе планирует выпустить GPT-5 , обещает Вау эффект...

Сообщение отредактировал c00l0ne - 25.7.2025, 5:46 -

у меня конечно нет настроения писать что-то

но тут очень много ИИ новостей :

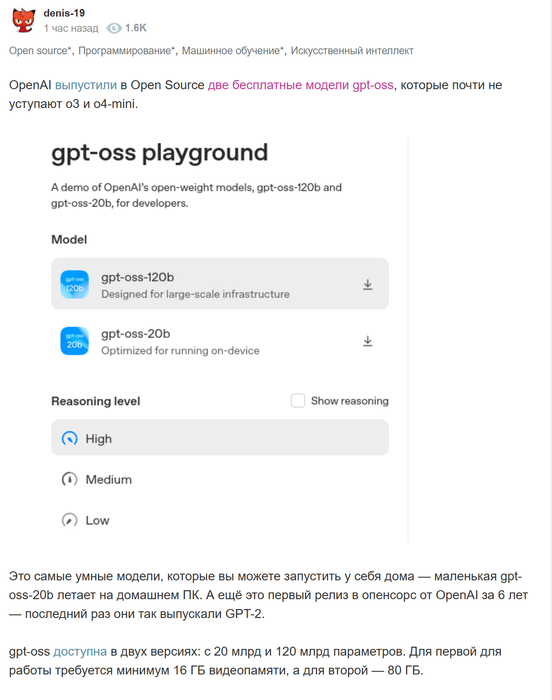

1) OpenAI вышла в open source, каждый может скачать новую модель , запустить

моделька бомба вау вау , что то на о3 похожая , но полностью автономная и управляемая на вашем компьютере

для БОЛЬшой нужна h100

для маленькой хватит любого компа

как появится настроение запилю гайд

2)

openai google и китайцы добились что модельки взяли все таки золотую медаль на олимпиаде по математике

олимпиады по математике всегда отличаются "умом и сообразительностью"

про решение о3 четвертой задачи в сложнейшем тесте FrontierMath:

Посмотрел свежее интервью (https://www.youtube.com/watch?v=EEIPtofVe2Q) с тремя ключевыми сотрудниками OpenAI, стоящими за системой, выигравшей золотую медаль на международной олимпиаде по математике. Новой информации не так много, тезисно:

— вся работа заняла буквально 2-3 месяца, и в большей степени вовлечено было 3 человека. Значимую часть времени трудился только Alex Wei, остальные два участника подключились попозже, когда время поджимало. Конечно, все трое общались и с другими командами, инфраструктура там, итд, но ядро вот всего три человека.

— Для задачи 6, самой сложной и решённой всего 6 участниками, Noam подчеркнул значимость способности модели отвечать «ответа нет», тем самым избегая галлюцинаций. Модель знала, что она не решила задачу, и пасовала — это очень важно для интеграции в работу реальных математиков.

— Noam упомянул, что основным узким местом при увеличении времени на обдумывание является оценка решений: если время рассуждений увеличить до 1500 часов, оценка займет столько же времени, что создаст существенный боттлнек.

— Если говорить о «Задачах тысячелетия (https://ru.wikipedia.org/wiki/%D0%97%D0%B0%D0%B4%D0%B0%D1%87%D0%B8_%D1%82%D1%8B%D1%81%D1%8F%D1%87%D0%B5%D0%BB%D0%B5%D1%82%D0%B8%D1%8F)», чрезвычайно сложных проблемах, решение которых практически не продвинулось даже после работы сотен учёных в течении десятков лет, то с точки зрения времени на рассуждениях решение потребовало бы увеличения текущего ~полуторачасового интервала, отводимого на решение задач IMO, в 1000 и более раз. Так что впереди ещё долгий путь.

— Noam возглавляет команду Multi-agent systems, и проговорился, что система, получившая золотую медаль, как раз использовала многоагентность, чтобы масштабировать параллельные вычисления. Однако система задумывается общей, без заточки только на математику, и сейчас начинается работа по интеграции решения в системы, доступные пользователям ChatGPT.

— Noam сказал, что одним из следующих препятствий станет поиск ответа на вопрос: «Как нам заставить модель придумывать новые сложные и полезные задачи?». Но он не видит препятствий, почему это не произойдет.

И в этом же контексте добавлю вот такую новость. Помните набор задач FrontierMath (https://t.me/seeallochnaya/1980) от Epoch.AI? Изначально там было 3 уровня сложности, и недавно появился четвёртый, задачи для которого взяты с границы того, что известно математикам сегодня. Всего там 48 задач, и до недавнего времени всего 3 задачи решались хотя бы какой-то моделью (в топе была (https://x.com/EpochAIResearch/status/1943744462972215305) o4-mini 😋).

o3 смогла решить четвёртую, сделав 32 попытки (лишь одна оказалась правильной). Автор задачи, профессор математики из UC, сказал (https://x.com/EpochAIResearch/status/1951432847148888520), что модель имела некоторые неправильные предпосылки, но в конечном итоге решила проблему, «сочетая превосходную интуицию относительно асимптотических явлений с ее способностью кодировать и выполнять сложные расчеты для проверки гипотез».

«Это выдающееся достижение модели o3. Она точно выявила ключевую идею, которую я закладывал при построении задачи, решение которой основано на (!) неопубликованной технике (!) асимптотического анализа, обобщающей мои результаты, которые лишь немногие люди в мире понимают на глубоком техническом уровне.»

Ждём моделек 2026-го года для продвижения фронтира 🥳

дальше будет только круче)

вероятность вымирания человечества от ии растет)

Сообщение отредактировал c00l0ne - 5.8.2025, 22:55 -

-

Bravo

Ps genie 3 ещё гляньте кто следит за иишкой

- Вы сможете оставлять комментарии, оценивать посты, участвовать в дискуссиях и повышать свой уровень игры.

- Если вы предпочитаете четырехцветную колоду и хотите отключить анимацию аватаров, эти возможности будут в настройках профиля.

- Вам станут доступны закладки, бекинг и другие удобные инструменты сайта.

- На каждой странице будет видно, где появились новые посты и комментарии.

- Если вы зарегистрированы в покер-румах через GipsyTeam, вы получите статистику рейка, бонусные очки для покупок в магазине, эксклюзивные акции и расширенную поддержку.

для LLM обучение дома остается недоступным, чтобы обучить LLM нужны тысячи тысяч , ну ладно просто тысячи топовых gpu, это миллионы долларов , НО после обучения нейронку уже можно запустить, для этого обычно используется кластер из видеокарт, ставят 3-4шт 3090 самая популярная и запускают используя их память 24х4 = 96 гбайт на локальном компьютере какую нибудь квантованную версию deepseek например , но это все равно оч медленно оч затратно и по электроэнергии мало эффективно

Для решения этой проблемы вот такие устройства выпускают потихоньку на базе архитектуры RISC-V :

https://habr.com/ru/companies/ruvds/articles/924240/

дальше почитать можно тут https://habr.com/ru/companies/ruvds/articles/924240/

думаю будущее за RISC-V, это ASIC'и для LLM, пока что все оч дорого(